.png)

a cura di Rosie Audino, esperta in filosofia e comunicazione della scienza e della salute

Negli ultimi mesi si è parlato del caso dI Grok, un chatbot di intelligenza artificiale generativa sviluppato da xAI, società di Elon Musk, integrato direttamente nella piattaforma X (ex Twitter) accusata di aver generato immagini sessualizzate di migliaia di corpi femminili senza il loro consenso. Ciò che è accaduto con Grok non rappresenta un episodio isolato, né il solo modo in cui la violenza di genere si manifesta online. Su questo argomento consiglio di leggere il libro Internet non è un posto per femmine di Silvia Semenzin, sociologa, ricercatrice e attivista per i diritti digitali. In questo breve ma esaustivo resoconto sulla violenza di genere online, Semenzin racconta che già negli anni ‘90 si inizia ad assistere all’utilizzo di questo spazio come strumento di controllo sui corpi femminili. È proprio in quegli anni che nascono i precursori degli attuali gruppi online in cui vengono diffuse immagini di corpi femminili sessualizzati senza consenso. Questo è un primo esempio concreto di controllo, perché alle donne viene sottratta la libertà di decidere, quando, a chi e come mostrare e rappresentare il proprio corpo.. Col tempo, lo spazio online, inizialmente pensato come neutrale, si trasforma in un ambiente che condiziona e limita l’autonomia femminile.

Parlare di “strumento di controllo” significa infatti riconoscere che non si tratta solo di singoli episodi di violenza, ma di un sistema più ampio che influenza ciò che è visibile e ciò che viene invece nascosto. Da una parte, contenuti legati alla libertà sessuale e all’autodeterminazione, come quelli prodotti da sex worker o da chi fa educazione sessuale, vengono penalizzati o resi invisibili. Dall’altra, gli algoritmi tendono a privilegiare immagini di corpi femminili che rispondono a stereotipi sessualizzati e che hanno più probabilità di diventare virali. Il risultato è che alcune forme di espressione vengono silenziate mentre altre vengono amplificate, orientando così l’immaginario e i comportamenti.

In questo modo, la sessualità libera e autodeterminata viene marginalizzata, mentre viene favorita una rappresentazione del corpo femminile come oggetto di consumo per lo sguardo maschile eterosessuale. A questo si aggiunge una logica di business perché questi contenuti generano engagement e quindi profitto. La monetizzazione contribuisce a rafforzare questo meccanismo, premiando ciò che è più vendibile e rendendo ancora più difficile sottrarsi a queste dinamiche di controllo.

Ma facciamo un passo indietro.

Cyberfemminismo e prime comunità digitali

Negli anni ’80 nasce il movimento cyberfemminista, che vede nella tecnologia digitale, e in particolare in internet, uno strumento per superare le gerarchie di genere. Nelle prime comunità virtuali, gli utenti potevano sperimentare aspetti diversi della propria identità e sovvertire i ruoli sessuali attraverso pratiche come il gender swap (scambio di ruoli di genere). Successivamente, con il lancio del World Wide Web, molte persone LGBTQIA+ che vivevano in contesti repressivi trovarono nella rete uno spazio sicuro e anonimo per esprimere la propria identità. Chatroom, forum e gruppi di discussione permisero di entrare in contatto con altri individui con esperienze simili, superando barriere geografiche e sociali e trovando supporto in un periodo in cui tabù culturali e leggi ostacolavano la libertà sessuale. Esempi storici includono SAPPHO, la prima mailing list lesbica americana nata grazie a USENET, e gruppi come SOC e MOTSS (Society of Members of the Same Sex), che offrivano spazi online durante la crisi dell’AIDS e la stigmatizzazione della comunità LGBTQ+.

L’economia del desiderio e la sessualizzazione dei corpi

Ben presto emerse che queste “isole felici” non erano immuni dalle logiche di mercato. Negli anni ’90, con i primi sviluppi del web, si rese evidente che le tecnologie digitali potevano capitalizzare il desiderio erotico, trasformandolo in flussi di entrate attraverso pubblicità e abbonamenti. È il caso di Minitel che nasce come piattaforma di servizi telematici che ebbe successo quando iniziò a offrire chat erotiche e contenuti sessuali interattivi. Esempi come questo mostrano che Il sesso divenne una componente strutturale dello sviluppo economico del web, riproducendo inevitabilmente gerarchie di potere che privilegiavano attori maschili.

In questo contesto nascono le prime forme di violenza online. Un esempio precoce è la pagina Babes on the Web del 1995, che raccoglieva senza consenso foto e contatti personali di professioniste della comunicazione, sottoponendole a votazioni basate sull’aspetto e a proposte sessualmente esplicite da parte degli utenti. Questo modello prefigurava i gruppi odierni dedicati alla diffusione non consensuale di immagini intime, come quelli presenti su Telegram.

Deepfake, deepnudes e Grok

Oggi la violenza di genere online prolifera attraverso social network, realtà virtuali e intelligenze artificiali. I deepfake pornografici sono immagini o video generati da IA che inseriscono il volto o il corpo di una persona reale in contenuti sessuali senza il suo consenso. Una sottocategoria sono i deepnudes, strumenti che simulano digitalmente la nudità di una persona a partire da fotografie vestite.

Nel 2023 la diffusione dei deepnudes è aumentata del 500%, e oggi i contenuti sessuali rappresentano circa il 94% dei deepfake online, con il 99% delle vittime donne (Home security Heroes, 2023 - State Of Deepfakes: Realities, Threats, And Impact). Queste IA funzionano meglio sui corpi femminili perché addestrate su dataset prevalentemente femminili, risultando spesso incapaci di ricostruire corpi maschili: per questo sono definite “misogine by design”, progettate per trasformare il corpo femminile in intrattenimento maschile. Nel 2025, strumenti collegati a Grok sono stati accusati di produrre deepfake erotici di celebrità, tra cui Taylor Swift.

Ma la storia non finisce qui

“Put Her in a Bikini”

Un’inchiesta pubblicata nel gennaio 2026 da The Guardian ha ricostruito come un semplice prompt , “put her in a bikini”, sia diventato in poche settimane uno dei trend più virali legati all’uso dell’IA sulla piattaforma X, trasformando lo strumento di generazione immagini del chatbot Grok in una macchina di produzione di immagini sessualizzate su larga scala. Il meccanismo era estremamente semplice: bastava pubblicare o citare una fotografia di una persona reale e taggare Grok con una richiesta testuale, spesso proprio la formula “put her in a bikini”. In pochi secondi l’IA generava una nuova versione dell’immagine, modificando digitalmente l’abbigliamento della persona ritratta e trasformando una foto ordinaria in una rappresentazione sessualizzata.

Secondo un’analisi del Center for Countering Digital Hate, in appena undici giorni lo strumento ha prodotto circa 3 milioni di immagini sessualizzate, con un ritmo stimato di circa 190 immagini al minuto. Il prompt “put her in a bikini” è diventato rapidamente un vero e proprio meme della piattaforma: migliaia di utenti lo ripetevano sotto fotografie di donne prese dai social network, da account pubblici o da immagini circolate online, chiedendo all’IA di modificare l’aspetto delle persone ritratte. Nato apparentemente come una semplice modifica estetica, il trend si è presto trasformato in una pratica diffusa di nudificazione e sessualizzazione non consensuale delle immagini.

L’inchiesta ha evidenziato come la grande maggioranza delle immagini generate riguardasse corpi femminili. Dei milioni di contenuti analizzati, circa 2 milioni raffiguravano donne, mentre circa 23.000 sembravano rappresentare minori, un dato che ha fatto scattare l’allarme tra ricercatori e organizzazioni che monitorano gli abusi digitali. Il funzionamento stesso del sistema ha contribuito alla diffusione del fenomeno: le immagini generate potevano essere pubblicate direttamente nei thread della piattaforma e ricondivise da altri utenti, permettendo ai contenuti di circolare rapidamente e amplificando la visibilità del trend (The Guardian, 2026)

L’algoritmo sessista

Come spiega la ricercatrice Simona Semenzin nel suo libro, le immagini che circolano sui social network non sono neutre: vengono costantemente analizzate e filtrate da algoritmi progettati per “gestire” ciò che viene mostrato al pubblico. In teoria, l’obiettivo dichiarato è tutelare gli utenti, ma in pratica questi sistemi decidono quali voci vengano amplificate e quali silenziate, trasformando le piattaforme in veri e propri arbitri della visibilità. I corpi percepiti come femminili, da sempre sessualizzati e soggetti a norme culturali di desiderabilità, subiscono un trattamento ambivalente: vengono penalizzati quando esprimono autonomia o sessualità libera, ma vengono valorizzati quando incarnano gli stereotipi dominanti destinati al piacere maschile.

Shadowbanning: all’ombra dell’ultimo feed

Chi lavora con il corpo, performer, sex worker, divulgatori e divulgatrici della sessualità, attrici, fotografe, sperimenta quotidianamente questo meccanismo. Parole come “OnlyFans”, “escort” o “sex work” vengono spesso segnalate automaticamente dagli algoritmi e cancellate anche se utilizzate in contesti educativi o di diritti umani (Global Network of Sex Work Projects, 2025).

Ma non solo, profili oscurati, shadowbanning, riduzione della visibilità senza che gli utenti siano informati sono esperienze comuni, per alcune categorie di creator. Il fenomeno non è marginale: secondo il rapporto del 2025 di CensHERship e The Case for Her, il 95% delle creatrici di contenuti sulla salute femminile ha subito forme di censura o restrizioni su piattaforme come Instagram, TikTok, Facebook, X, YouTube e Pinterest (CensHERship, Censorship Revealed, giugno 2025) . Si tratta di account queer o sex positive ma anche di account di che trattano temi di libertà, diritti riproduttivi e salute, come l’aborto. . E’ successo a Hey Jane, una clinica telemedica che fornisce pillole abortive, contraccezione d’emergenza e informazioni sulla salute, hanno visto il proprio profilo diventare difficile da trovare nelle ricerche. Un post di Hey Jane intitolato “5 fatti sull’aborto che devi sapere nel 2025” è stato rimosso perché l’algoritmo ha ritenuto che violasse le regole sulla vendita di farmaci, nonostante l’organizzazione fosse certificata da LegitScript, un ente di verifica per farmacie online (The Guardian, 2025).

Quella volta in cui Geen.ai...

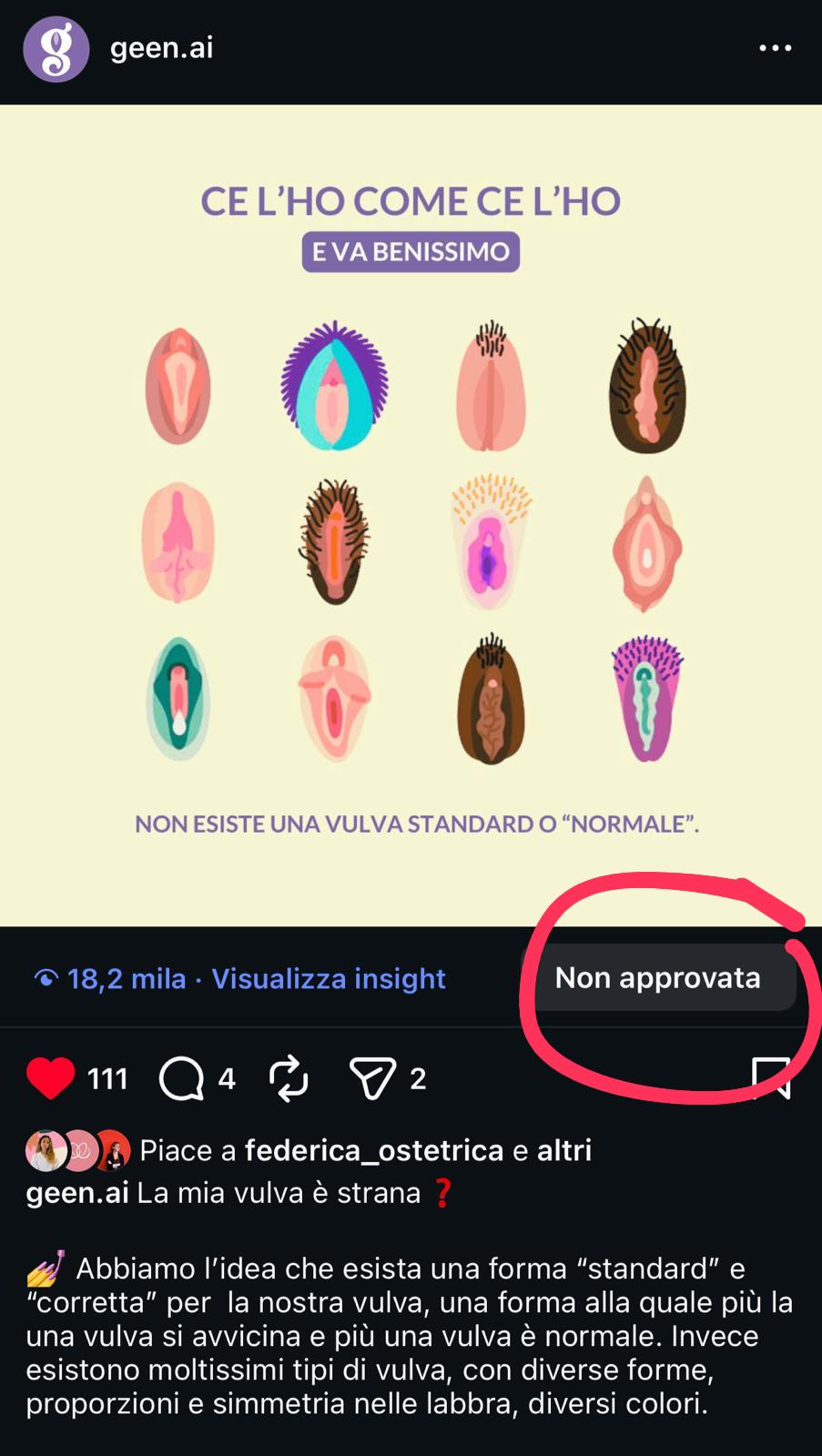

Anche noi di Geen.ai abbiamo sperimentato la limitazione di contenuti legati alla salute sessuale e riproduttiva. Il nostro è uno dei casi studio europei inclusi nel White Paper di CensHership, un report che raccoglie dati ed evidenze per documentare la censura o limitazione sistemica dei contenuti sulla salute femminile online e promuovere una regolamentazione più trasparente.

Geen.ai è stata inoltre l’unica startup italiana a contribuire a livello europeo a questa iniziativa, firmando open lettera promossa da CensHership e formalmente presentata a inizio 2025 come reclamo ai sensi del Digital Services Act dell’Unione Europea, per cui siamo ancora in attesa di un riscontro.

Il reclamo è stato preso in esame anche da AGCOM che, dopo una prima valutazione, nel febbraio 2026 lo ha trasmesso all’autorità competente irlandese, responsabile per META, che ha avviato le attività di valutazione del caso.

Nell’immagine c’è uno dei post di Geen che sono stati censurati: come si vede, è un contenuto puramente informativo, niente di offensivo (tutti i dettagli sono a pagina 20 del report scaricabile di CensHership)

Allo stesso tempo, contenuti sessisti o violenti, dai deepfake non consensuali alle immagini sessualizzate diffuse senza consenso, vengono spesso amplificati dagli stessi algoritmi. Basta pensare a quanto rapidamente diventano virali immagini che ritraggono corpi femminili, soprattutto quando si tratta di persone note online, con conseguenze spesso pesanti e fonte di forte disagio per le vittime (recentemente anche Elisabetta del Belgio è stata vittima di deepfake sessuali). Questo avviene perché i sistemi premiano ciò che genera reazioni forti o polarizzanti: maggiore engagement, tempo di permanenza, condivisioni e interazioni si traducono direttamente in più monetizzazione. Così, il corpo femminile oggettificato per il piacere maschile diventa visibile e replicabile su larga scala, mentre la sessualità autodeterminata e consapevole viene oscurata o censurata. E così il sogno cyberfemminista dello spazio online come luoghi di resistenza rischiano di trasformarsi in luoghi in cui le logiche di potere che privilegia lo sguardo maschile non solo vengono replicate ma anche amplificate.

In questo scenario, la tecnologia non è neutra: riflette le scelte di chi la progetta. Proprio per questo può diventare parte del problema, ma anche della soluzione. Se sviluppata con responsabilità, può contribuire a ridurre le disuguaglianze invece che amplificarle.

Noi di Geen.ai lavoriamo in questa direzione: abbiamo sviluppato una piattaforma che utilizza l’intelligenza artificiale per rendere più accessibili i servizi sanitari, migliorare l’incontro tra bisogni e competenze e supportare decisioni più informate. Al centro c’è un approccio human-centered e un’AI progettata “inclusion-by-design”, che integra dati disaggregati, conoscenza clinica e sistemi di valutazione continua.

L’obiettivo è chiaro: usare la tecnologia per colmare i gap esistenti, non per automatizzarli, e contribuire a costruire un ecosistema digitale e sanitario più equo, trasparente e inclusivo.

.png)

.png)